Kettle入门之一 介绍、安装

数据整合是吧在不同数据源的数据收集、整理、清洗、转换(有点像ETL)后,加载到一个新的数据源,为数据使用者提供统一数据视图的数据集成方式。

数据整合是共享或者合并来自于两个或者更多应用的数据,创建一个具有更多功能的企业应用的过程。传统的商业应用有很强的面向对象性——即他们依靠持续的数据结构为商业实体和过程建模。当这种情况发生时,逻辑方式是通过数据共享或合并进行整合,而其他情况下,来自于一个应用的数据可能是重新构造才能和另一个应用的数据结构匹配,然后被直接写进另一个数据库。

下面我们将介绍一个目前比较成熟稳定的数据整合工具:Kettle

Kettle 介绍

Kettle是一款国外开源的ETL工具,纯java编写,可以在Window、Linux、Unix上运行,绿色无需安装,数据抽取高效稳定。

Kettle 中文名称叫水壶,该项目的主程序员MATT 希望把各种数据放到一个壶里,然后以一种指定的格式流出。

Kettle这个ETL工具集,它允许你管理来自不同数据库的数据,通过提供一个图形化的用户环境来描述你想做什么,而不是你想怎么做。

Kettle中有两种脚本文件,transformation和job,transformation完成针对数据的基础转换,job则完成整个工作流的控制。

Kettle目前包含五个产品:Spoon、Pan、Chef、Kithcen、Encr。

SPOON: 是一个图形用户界面,允许你通过图形界面来设计ETL转换过程(Transformation)和任务。

PAN: 转换(trasform)执行器;允许你批量运行由Spoon设计的ETL转换 (如使用一个时间调度器)。Pan是一个后台执行的程序,没有图形界面。

CHEF: 允许你创建任务(Job)。 任务通过允许每个转换,任务,脚本等等,更有利于自动化更新数据仓库的复杂工作。任务通过允许每个转换,任务,脚本等等。任务将会被检查,看看是否正确地运行了。

KITHCEN: 作业(job)执行器;允许你批量使用由Chef设计的任务 (如使用一个时间调度器)。KITCHEN也是一个后台运行的程序。

ENCR: 用来加密连接数据库密码与集群时使用的密码

Kettle 下载和部署

1、 下载

我们可以进入Kettle官网进行下载,进入之后,下拉页面,看到如图所示;

直接下载最新版就好啦.

2、 Kettle 环境配置

由于Kettle是使用Java语言编写的,所有Kettel的运行需要有Java环境,安装JDK,请参考:Linux环境下JDK安装和配置 和 Windows环境下JDK安装和配置

3、 运行Kettle

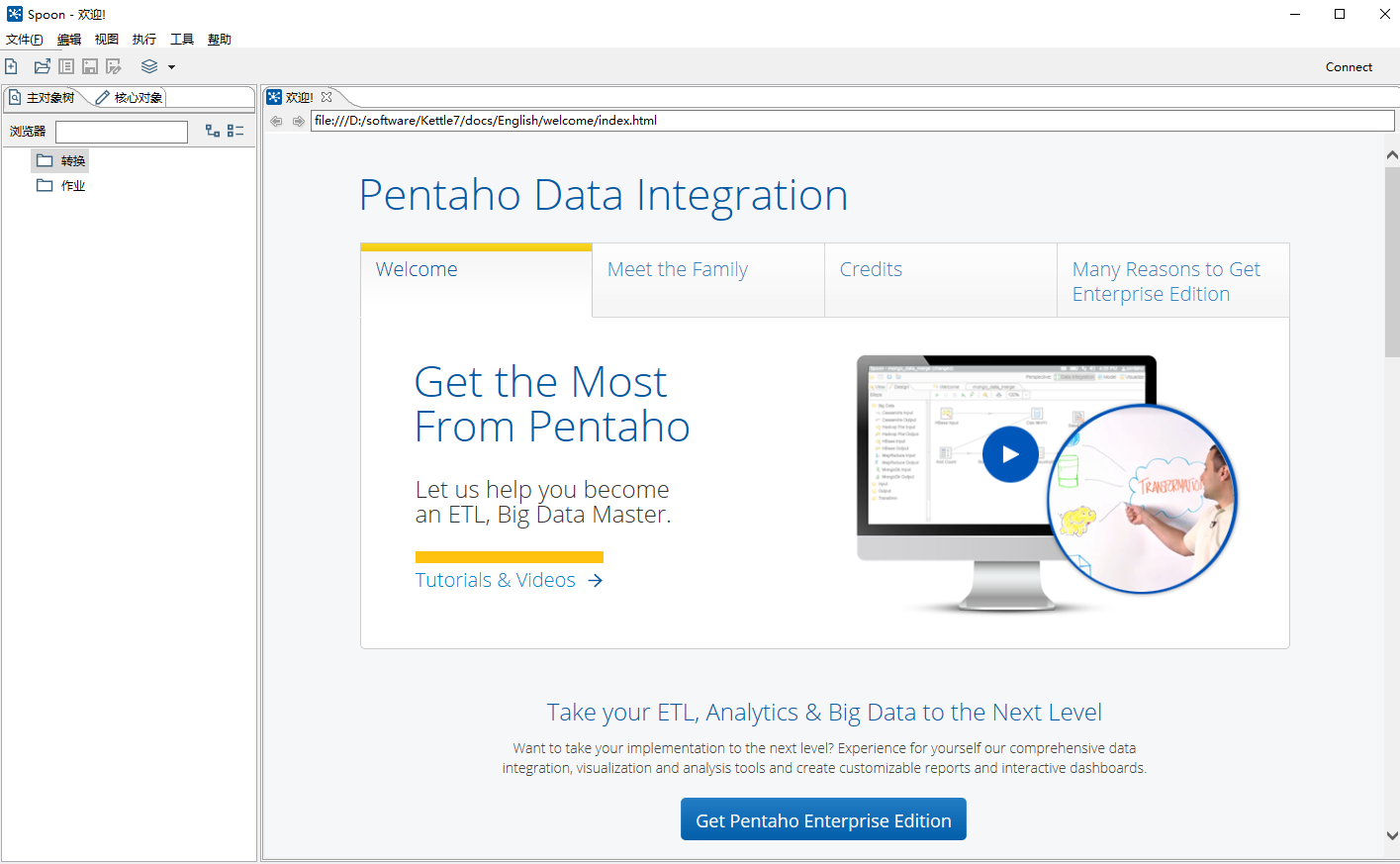

进入到Kettle目录,如果Kettle部署在windows环境双击Spoon.bat文件启动Kettle,如果是在Linux环境下,则运行spoon.sh文件启动。出现如下界面,则我们的Kettle就安装成功了。

至此,Kettle的下载、环境配置和安装就基本完成了。

(完)

文章抄自:开心跳蚤